进阶因子工程热门课程

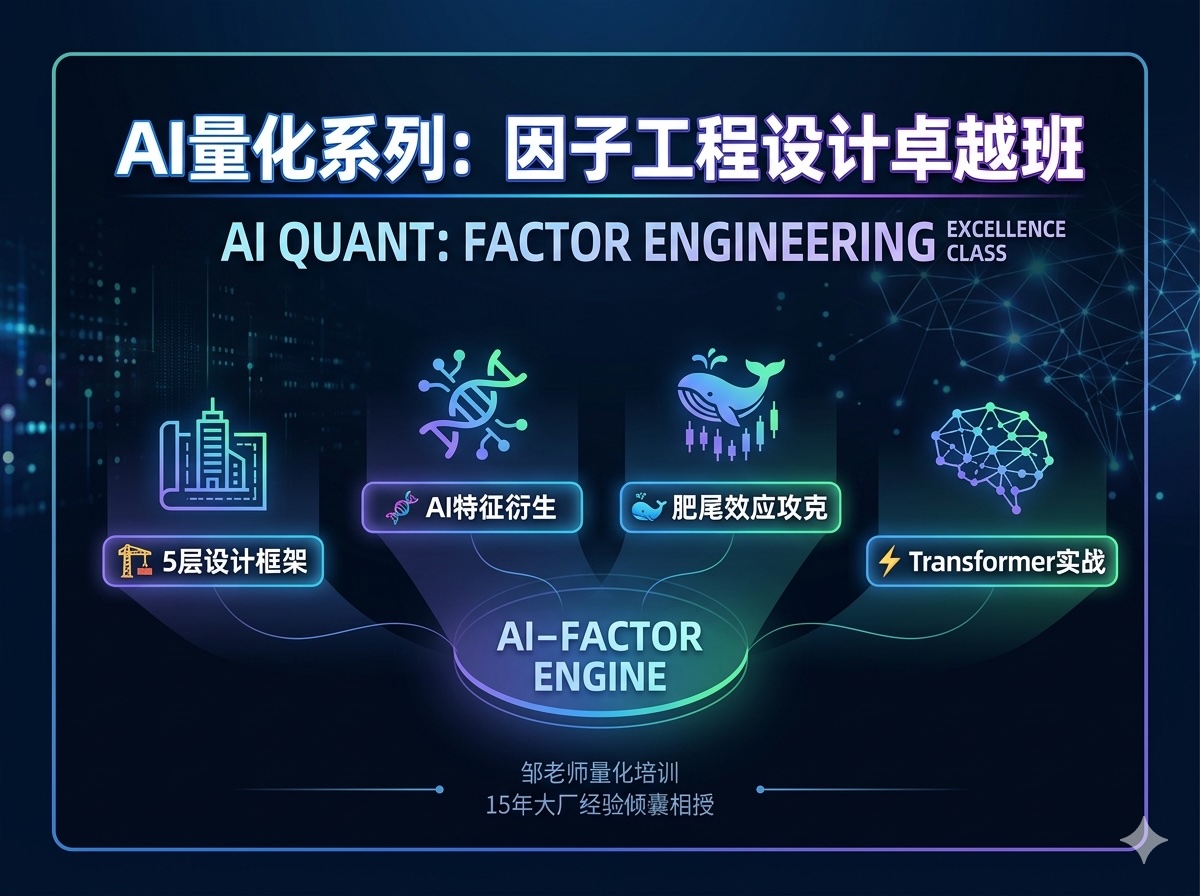

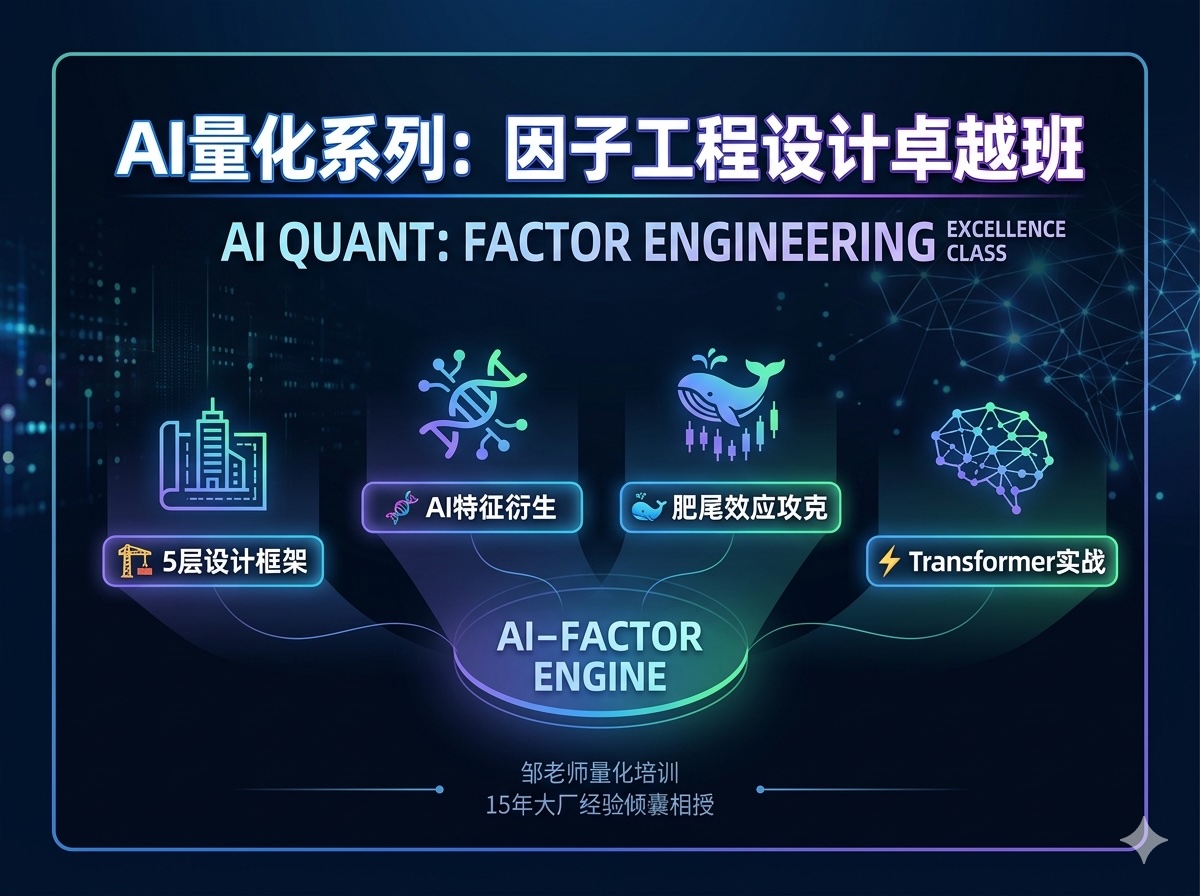

查看详情因子工程设计卓越班

围绕因子工程搭建完整设计框架,覆盖 AI 特征衍生、策略因子设计和可进化的因子体系。

4.9 (645评价)645人学习12小时6节

围绕因子工程搭建完整设计框架,覆盖 AI 特征衍生、策略因子设计和可进化的因子体系。

¥8,999

结合 2026 年 AlphaForgeBench 等新研究,解释为什么把 LLM 作为交易动作执行体容易产生不稳定与不可复现问题,而将其定位为因子和策略研究助手更符合量化生产逻辑。

如果你想把这篇文章里的方法系统化学习,可以从这些课程继续深入。

围绕因子工程搭建完整设计框架,覆盖 AI 特征衍生、策略因子设计和可进化的因子体系。

围绕因子工程搭建完整设计框架,覆盖 AI 特征衍生、策略因子设计和可进化的因子体系。

聚焦 AI 大模型在量化研发中的提效场景,覆盖因子代码孵化、研报转策略、向量化改写、回测系统搭建与生产级代码协作。

聚焦 AI 大模型在量化研发中的提效场景,覆盖因子代码孵化、研报转策略、向量化改写、回测系统搭建与生产级代码协作。