进阶因子工程热门课程

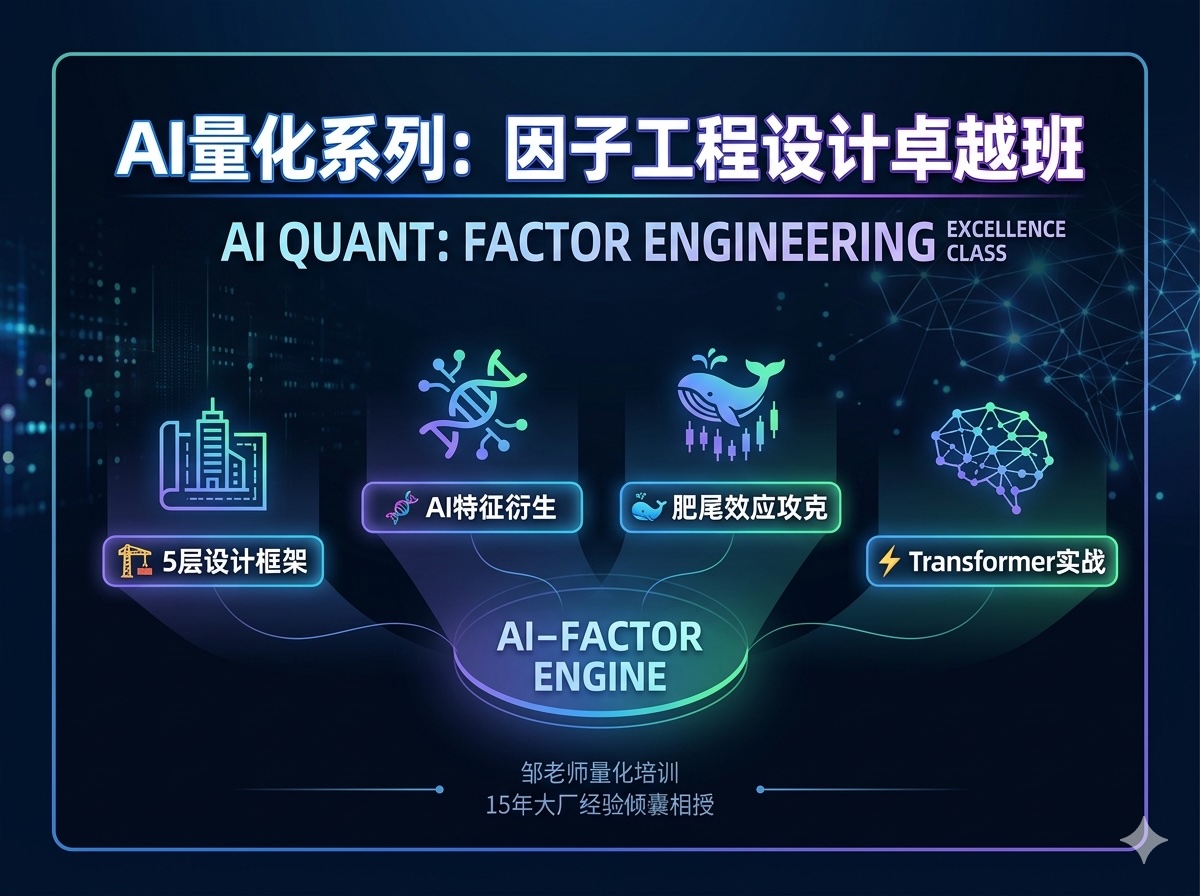

查看详情因子工程设计卓越班

围绕因子工程搭建完整设计框架,覆盖 AI 特征衍生、策略因子设计和可进化的因子体系。

4.9 (645评价)645人学习12小时6节

围绕因子工程搭建完整设计框架,覆盖 AI 特征衍生、策略因子设计和可进化的因子体系。

¥8,999

结合高维资产定价中的 shrinkage、spanning regression 与滚动窗口设定,解释为什么因子筛选需要显式稀疏化、如何避免前视偏差,以及稀疏框架能给研究者带来什么。

如果你想把这篇文章里的方法系统化学习,可以从这些课程继续深入。

从 AI ETF 主被动比较、国债 ETF 久期轮动,到 GJR-GARCH 期权定价,这组论文提醒团队:资产配置研究如果不把实现规则写清,结论很容易只剩样本内说服力。

当研究对象横跨中美欧日和多种资讯来源时,只在英文语料里做语义检索,等于主动丢掉大量非对称信息。

从印度六因子模型、XDlasso 高维预测回归,到贝叶斯随机波动率模型,这组论文提醒团队:因子研究的第一性问题不是变量数量,而是推断是否可信。