进阶因子工程热门课程

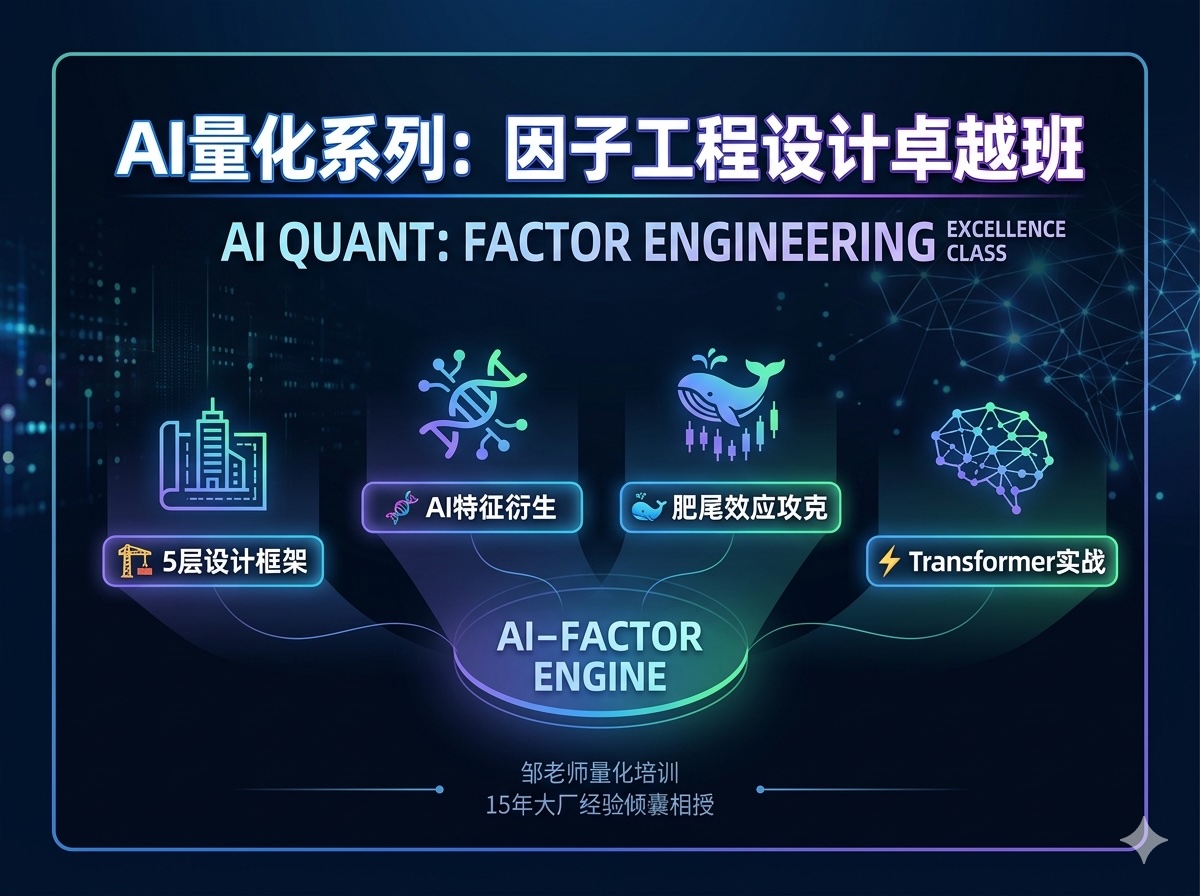

查看详情因子工程设计卓越班

围绕因子工程搭建完整设计框架,覆盖 AI 特征衍生、策略因子设计和可进化的因子体系。

4.9 (645评价)645人学习12小时6节

围绕因子工程搭建完整设计框架,覆盖 AI 特征衍生、策略因子设计和可进化的因子体系。

¥8,999

结合可解释机器学习中的 SHAP 与 SAGE 思路,解释为什么机器学习语境下的因子重要性高度依赖方法、样本与频率,以及研究者应如何更稳地使用重要性分析。

如果你想把这篇文章里的方法系统化学习,可以从这些课程继续深入。

Decomposition-Enhanced Network、GTH-Net 与多源深度风险预测论文共同提醒团队:模型复杂度本身不值钱,只有在 regime、损失函数和误差后果被说清时才有研究价值。

从多源财务风险预测到加密时序可解释性论文,再到股票预测综述,这组工作真正有价值的部分不是 AI 更强,而是让团队看到哪些失败方式必须先被写出来。

多个大模型一起读公告时,真正该保留下来的往往不是谁投了赞成票,而是它们为什么分歧、分歧集中在什么类型的披露上,以及这种分歧能否被二层模型转成更稳定的标签。